Apple 又有新功能登場!說的是日後 Apple 會藉 NeuralHash 審查系統,辨識在 iCloud 的照片有否包含兒童色情圖像,如查證資料屬實的話,該 iCloud 帳戶持有人會移交執法部門審理的。

- Apple 將會推出新功能,辨識在 iCloud 的照片有否包含兒童色情圖像

- 此功能名為 NeuralHash 審查系統

- 當中會應用於 iOS 15、iPadOS 15、watchOS 8 和 macOS Monterey 更新

【相關報道】iOS 15 支援自動移除照片炫光功能 需符合 5 大條件【下一頁】

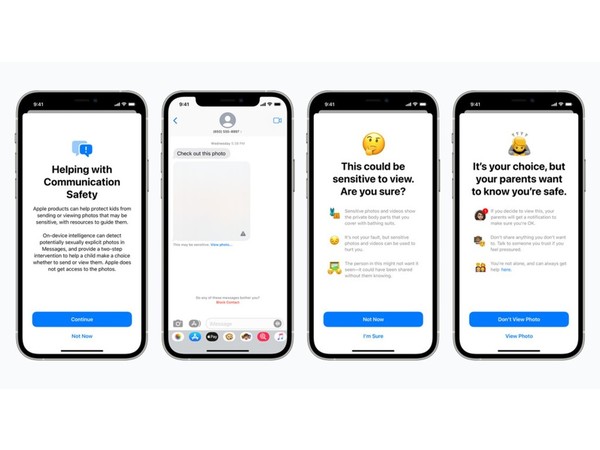

Apple 將會推出的新功能名為 NeuralHash 審查系統,當中會以美國國家失蹤與被剝削兒童中心 NCMEC 提供的數據進行比對,若查證資料屬實的話,該 iCloud 帳戶持有人會移交 NCMEC 及執法部門審理,有關功能會應用於 iOS 15、iPadOS 15、watchOS 8 和 macOS Monterey 更新。另外,Apple 也新增兩項功能制止兒童色情傳播問題,如 iMessage 將備審查兒童帳號附加相片功能,當檢測到發送或收取的圖片有異時,系統會進行模糊處理及彈出警告,而父母 iCloud 帳號也會收到相關通知。另一項功能是避免 Siri 出現語音搜尋兒童色情項目,並警告用家有關行為是有風險的。

【相關報道】Apple Mac Pro 新推 Radeon Pro W6000-Series 效能增 84%【下一頁】

【相關報道】Apple Store 藉 App Clips 功能 直接掃產品 barcode 快速支付買配件【下一頁】

即刻【按此】,用 App 睇更多產品開箱科技影片

Source: BBC