Google 於昨日(26 日)正式宣布,旗下 AI 對話搜尋功能「搜尋 Live」(Search Live),即日起擴展至全球超過 200 個國家及地區,當中包括香港。這意味著用戶以後無須再輸入關鍵字搜尋,單純靠對話便能與 AI 搜尋功能互動,若有難以描述的情況,亦可以啟用相機鏡頭,讓 AI 理解你所看到的畫面後再回應。

Gemini 3.1 Flash Live 賦能 原生多語言對話更自然

「搜尋 Live」為 AI 模式的升級版,最早於去年 7 月率先在美國推出,隨後擴展至印度。推動是次全球化的核心技術,正是在於 Google 全新推出的 Gemini 3.1 Flash Live 模型。

據 Google 表示,該模型具備原生多語言處理能力,並可支援全球多國語言。相比前代,新模型在回應速度與穩定性上均有顯著提升,且對話脈絡的保留時長增加一倍,因此讓用戶以最直覺的母語,與搜尋引擎進行連續性、來回往復的對話。

結合鏡頭視覺情境 解決「難以言傳」的搜尋需求

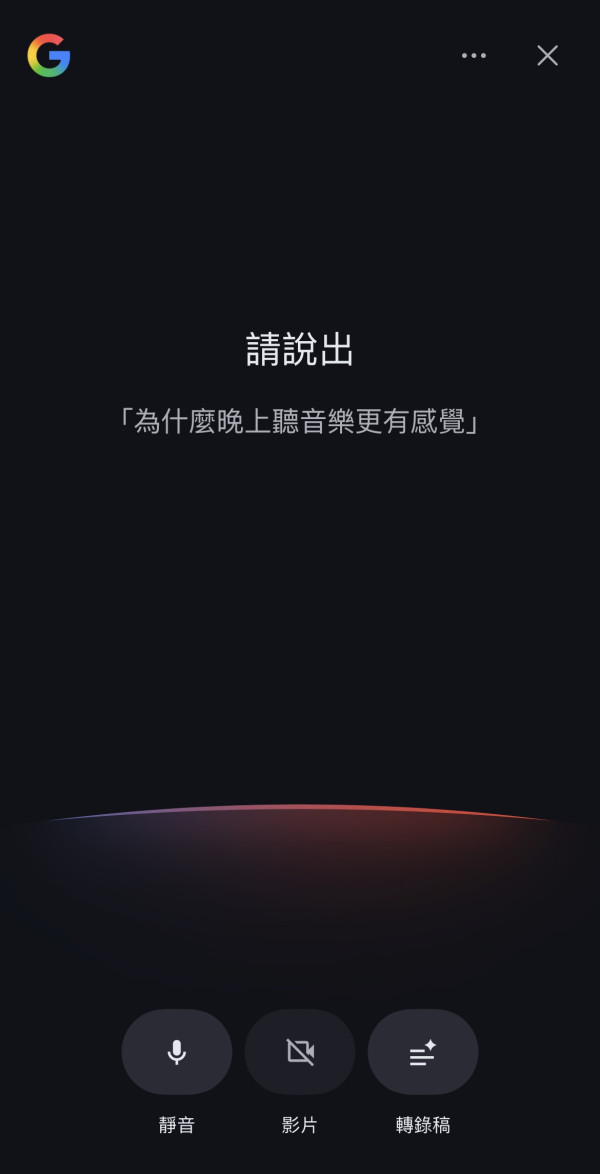

Google 指出,「搜尋 Live」是為了應對難以透過文字描述的即時場景。若要啟用「搜尋 Live」,用戶只需在 Android 或 iOS 裝置開啟 Google App,點擊搜尋列下方的「Live 圖示」,即可進入語音互動介面。

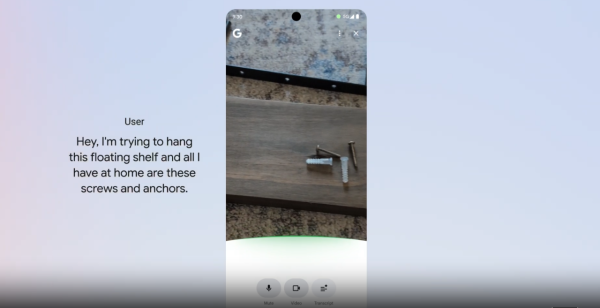

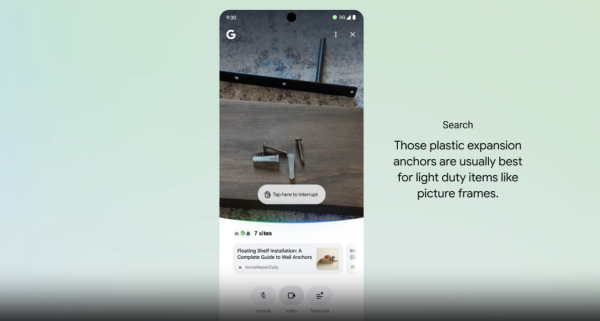

該功能最大的亮點在於結合相機鏡頭。當用戶面對現實生活中的難題,例如「如何組裝這組層架」,或辨識眼前物體時,可開啟相機功能讓 AI 直接觀看畫面。系統會根據場景提供精準建議,並附上相關網頁連結以供深入查閱。

是次更新或意味著,未來的搜尋功能,並不會再著眼於傳統的「關鍵字輸入」,而是會融入全新的「即時對話 + 看圖理解」模式,如何透過不同環境資訊,讓 AI 對你的問題更融會貫通,將會是用「搜尋」功能的重點。

目前「搜尋 Live」已陸續在全球各地區上線,小編的手機亦已經用到!開啟該頁面後便提出你的問題,等待數秒後畫面會跳出「輕觸這裡即可中斷」,點擊畫面後 AI 便知道你已結束提問,等陣數秒便會給予有關搜索結果。

若要使用相機,則可以點擊下方「影片」按鍵,並在相機開啟時提出你的問題。小編問的是:「桌上的這部裝置是甚麼?」AI 搜尋約十幾秒後便給出「Mac Mini」的答案。

即刻【按此】,用 App 睇更多產品開箱影片

【熱門報道】

Source:Google

【相關話題】Gemini 圖像生成終極攻略!Google 親自教路 4 大指令秘技

隨著 Google Gemini 於香港全面開放,相信不少讀者都已經試用過其強大嘅 AI 寫文功能。但其實 Gemini 內置嘅「圖像生成」工具同樣極具殺傷力!官方早前將 Gemini 嘅生圖模型升級為 「Nano Banana 2」,並同步公開詳細嘅終極指令(Prompt)教學。

Source:ezone.hk

【相關話題】Gemini 香港全面開放!官方親授 10 大 Prompting 技巧

Gemini 今日(26日)終於全面開放於全港用戶!想必各位讀者已經迫不及待想命令自己的 Gemini。不過如何精準下達指令亦是一門學問。而事實上 Google Workspace 團隊一早已為用戶準備好一本 Gemini 官方指南《Prompting guide 101》,詳盡披露與 Gemini 溝通的技巧,教你如何正確下指令。

Source:ezone.hk