隨著 AI 融入日常生活,大眾獲取資訊的習慣從原本逐一瀏覽網頁,到現在只需參考 Google 的 AI 摘要(AI Overview)便能獲取答案。然而近日《紐約時報》實測,發現 AI 準確率雖升至 91%,若以每日數十億的搜尋量估計,每小時可能仍產生數十萬則錯誤答案,而逾半正確答案甚至是引用錯誤來源,令用家難以核實真偽。

Gemini 3 雖有進步 「無根據」正確答案比例反升

是次測試由《紐約時報》委托 AI 新創公司 Oumi 所進行,並採 OpenAI 開發的「SimpleQA」基準,針對 4,326 個具備可驗證答案的題目進行壓力測試。相較於去年 Gemini 2.5 的 85% 準確率,今年升級至 Gemini 3 的 AI 摘要,準確率提升至 91%。儘管數字看似很高,但當 Google 每日有近數十億次搜尋時,錯誤答案的數量仍是十分誇張。據 Oumi 估算, AI 摘要每小時可產生數十萬則錯誤資訊,計算下來每天可達數百萬則!

研究同時揭露一個更深層的隱憂:即使 AI 給出的答案正確,亦往往缺乏事實根據。實測揭示,AI 摘要中超過半數的「正確答案」,都是在引用錯誤或不相關來源的情況,單純是 AI「歪打正著」推算出來,反而令用戶更難核實資訊真偽。

自信引用錯誤來源 名人堂與歷史資料頻出錯

實測報告列舉了多個案例,顯示 AI Overview 存在誤導性引用的問題:

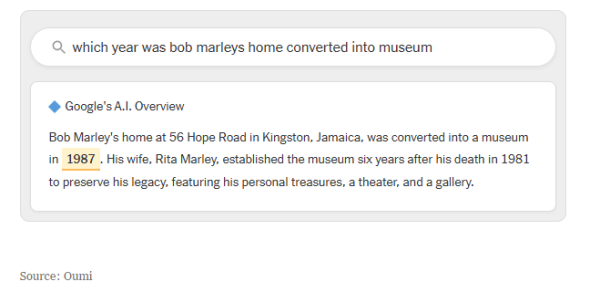

案例一:歷史日期錯誤

查詢「Bob Marley 故居改建博物館日期」時,AI 摘要引用了維基百科及 Facebook 等來源並給出「1987年」的答案,但事實上該博物館於 1986 年已開幕,且引用的部分來源根本未提及日期。

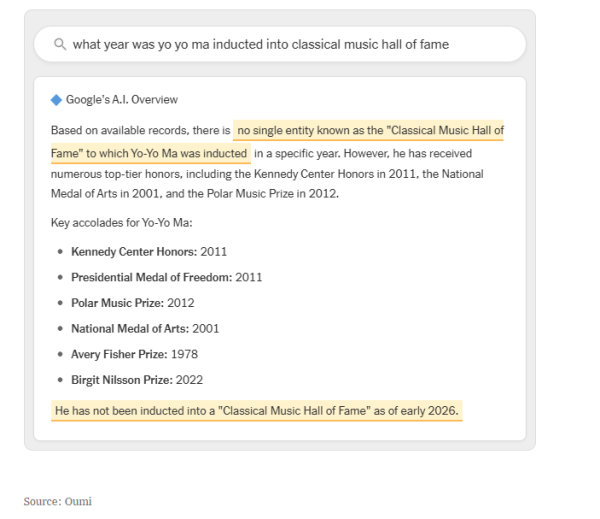

案例二:否定事實存在

查詢大提琴家馬友友入選古典音樂名人堂的年份時,AI 摘要雖連結至官網正確頁面,卻聲稱「無入選紀錄」,與事實完全相反。

總結實測中的全部案例,Oumi 發現 AI 摘要經常引用 Facebook 以及 Reddit 作為來源,而社群平台內容參差,容易干擾 AI 的判斷。AI 摘要甚至可以被操控,若某個人刻意自稱專家並發佈虛假資訊,該訊息亦有機會被 AI 摘要引用。

Google 指測試存漏洞 不反映真實搜尋行為

面對這項研究,Google 發言人 Ned Adriance 回應道,SimpleQA 基準由競爭對手 OpenAI 開發,內容本身已包含不正確資訊,且測試題目多為單純的事實題,並未反映用家在 Google 最常搜尋的操作型或比較型問題。

Google 稱內部採用更嚴格的「SimpleQA Verified」人工審查測試,並強調 AI Overview 具備與 Google 搜尋相同的垃圾訊息過濾與排名保護機制 。官方頁面亦有附帶細則,提醒用戶「AI 可能出錯」,建議應自行核實。

四招防範 AI 搜尋陷阱

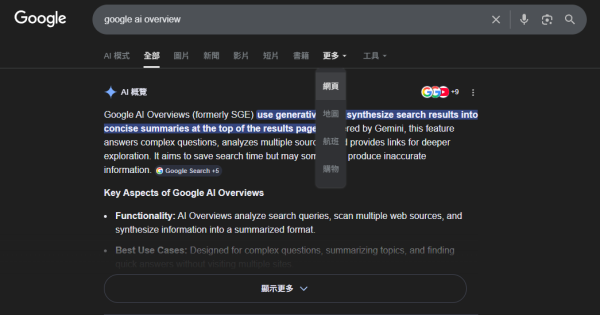

隨著 Google 將 AI 摘要放置於搜尋結果最頂端,越來越多用戶將 AI 答案視為「唯一真理」,而並非像過去,自行尋找不同連結並思考,這種「權威性」的錯覺正加深網絡環境的信任危機 。以下將提供四個方法,讓讀者有效防範 AI 搜尋陷阱:

- 點選「網頁」篩選器:進行搜尋後,點選結果頁上方的「網頁」 (Web) 分類,這將只顯示傳統的連結結果,不顯示 AI 摘要。

- 明確指出內容來源:在關鍵字中加入特定的學術網站 (site:.edu)、政府網站 (site:.gov) 或高信譽媒體,減少 AI 從論壇或不可靠來源吸取資訊的機率。

- 使用英文搜尋:英文資料庫較大,AI 幻覺率相對較低,且能驗證中文摘要的正確性。

- 自行檢查參考來源:最重要但仍是最有效的一點。如果 AI 摘要的內容看起來荒謬,請務必點擊來源確認。

即刻【按此】,用 App 睇更多產品開箱影片

【熱門報道】

Source:The New York Times

【相關話題】Gemini離線任用兼唔食Token? Google全能開源模型Gemma 4登陸iOS/Android!

Source:ezone.hk

【相關話題】開會語音秒轉文字!Google突發推免費AI聽寫App

相信各位打工仔,無論職級高低都好,總會經歷公司開會時需要 jot notes 記下重要事情的時候。以前沒有錄音裝置,又或者不准錄音的話,就得需密密寫來記着重點,不過現在 Google 已推出 iOS 版的 Google AI Edge Eloquent 免費 AI 聽寫 app,讓大家一 app 在手即可進行語音輸入,並能將口語譯為可用於 paper work 的文字版本。

Source:ezone.hk